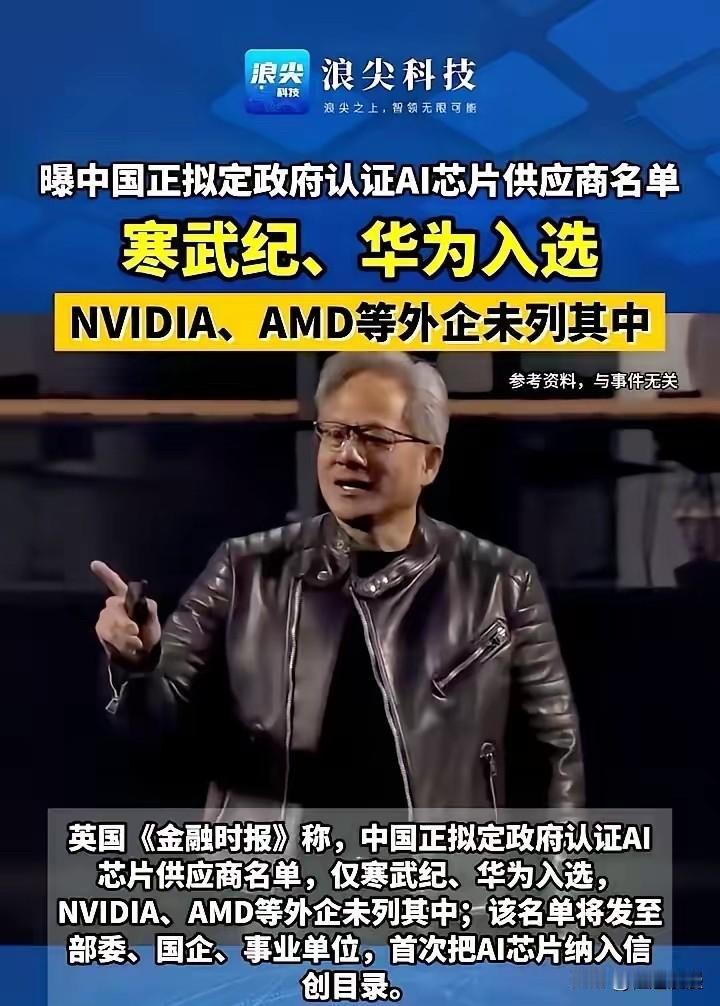

AI 正从“发展狂潮”进入“安全治理与风险管理”阶段。 多国政策层面、国际标准机构和企业实战都显示,AI 的安全问题已经不能被忽视,开始从理论转向实际落地。 首先在国际治理层面,美国国家标准与技术研究院(NIST)发布了针对 AI 的网络安全框架草案(Cybersecurity Framework Profile for AI),明确提出用成熟的安全架构来管理 AI 系统风险,这不是某家产品的优化,而是全球范围内推动 AI 安全规范化的重大举措。 与此同时,多家安全厂商发布了面向 AI 数据中心的联合解决方案,强调从网络层、存储层到模型层的全链路防护,这意味着未来 AI 应用不只是算力竞争,还会成为“安全竞赛”。 这些都是实际落地的安全实践,而不是抽象口号。 这场安全治理加速发生的背景不难理解:过去几年 AI 功能层出不穷,但缺乏统一的风险框架和技术保障;如今 AI 不仅嵌入企业核心流程,还在基础设施级别产生新的脆弱点——例如自动化攻击、模型中毒、数据泄露等。安全专家已经明确指出,AI 既是推动业务增长的引擎,也是新的攻击面。 AI 的未来不再只看谁模型更大、功能更强,而是谁能把它安全、可控、稳定地“融入日常业务与系统”中。安全不仅是 IT 部门的事,而是产品架构、运维策略与合规体系必须一起面对的核心问题。 对普通用户和企业来说,这里有三条现实建议: 1️⃣ 不要只关注 AI 功能堆叠,优先评估安全与隐私风险; 2️⃣ 企业在部署 AI 时,应把安全框架纳入首要路线,而不是事后补救; 3️⃣ 个人用户同样要关注设备权限与数据出口,而不是一味追新。 技术成熟的标志,不是“无风险”,而是“能把风险掌握在可控范围内”。 🔹 你觉得 AI 最大的安全隐忧是什么?是数据泄露、自动化攻击还是误用误判?