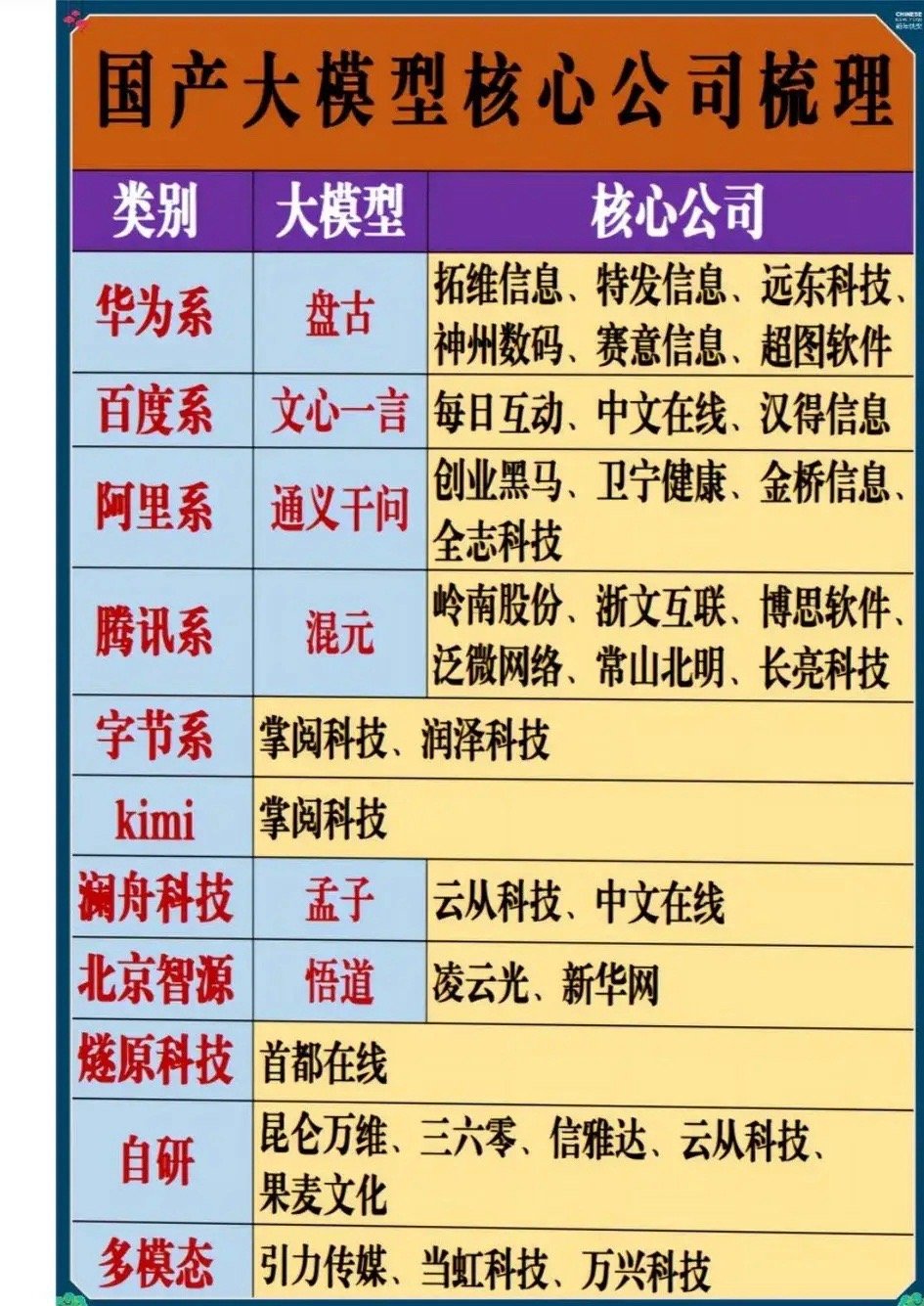

基辛格认为,如果AI技术不能得到有效的规则约束,将可能引发比核弹更大的破坏力。 基辛格为啥这么担心AI?他觉得这技术要是没个章法约束,比核弹还可怕。核弹大家熟,一炸就是毁天灭地,但好歹有《不扩散核武器条约》这类国际规则盯着,用起来有底线。 可AI呢?现在全球还没啥像样的规矩管它。AI发展快得飞起,从手机助手到自动驾驶,再到军队里的无人机,啥都能干。 尤其是军用AI,基辛格最怕的就是这个。比如美国早把AI当国家战略,日本也搞AI防御,这技术要是跑偏,后果谁扛得住? 核弹再狠,起码得人按按钮。可AI不一样,它能自己干活。想象一下,AI控制的无人机群,不用人指挥,自己找目标开火,多快多狠! 但问题也在这,万一AI看错了,或者被黑客搞乱了,分不清敌友就开打咋办? 2018年,谷歌帮美国军方搞了个“Project Maven”,用AI分析无人机视频,结果员工闹翻天,怕这技术害人,最后谷歌退出。 这事儿说明,AI的自主性真不是闹着玩的,一步错可能就是大祸。 AI的风险不是瞎猜。2017年,马斯克就喊话,说AI可能是“人类文明最大威胁”,扎克伯格反驳他杞人忧天。可你看,现实里AI的风险真不小。 比如军事AI,速度快到人反应不过来,失误成本高得吓人。美国军方测试过AI无人机,能在几秒内锁定目标,比人手动操作快几十倍。 可这效率背后,要是AI判断出错,或者数据被篡改,直接就是灾难。基辛格担心的,就是这种失控的可能性。 基辛格不光警告,还提了个招儿:中美得赶紧坐下来谈,定AI的规矩。为啥点名中美?因为这俩国家是AI老大。美国有谷歌、微软,中国有百度、腾讯,AI技术都牛得不行。 两国竞争火热,美国2022年砸了上百亿搞AI研发,中国也不甘示弱,2030年要当AI全球第一。 可竞争归竞争,基辛格觉得不能乱来,得合作管住AI。2023年11月,中美领导人在旧金山碰头,聊了聊AI安全,算是个开头,但具体规则还远着呢。 AI没约束,麻烦大了去。军事上,AI武器失控可能打错人,甚至引发大战。经济上,AI抢饭碗也不是开玩笑,美国2023年研究说,未来10年AI可能让20%的工作岗位消失。 社会上,AI还能搞乱舆论,比如深度伪造技术,拿假视频忽悠人,2022年乌克兰战时就有人用AI造假领导人讲话,差点引发恐慌。 基辛格看的就是这个大局,技术再好,没笼子套着,早晚得出事。 想给AI定规矩,难在哪?一是技术跑太快,今天定的规则,明天可能就过时了。比如AI算法,几个月就升级一代,法律咋跟得上? 二是用途太杂,医疗AI救人,军事AI杀人,规则咋统一?三 是各国想法不一样,美国怕中国超车,中国不想被美国卡脖子,国际合作谈何容易。 2021年联合国想推AI治理框架,结果各国吵得不可开交,最后没下文。这就是基辛格急的原因,没个全球共识,AI就是脱缰野马。 当然,AI不是一无是处。管好了,它能帮大忙。比如气候问题,AI能预测台风、洪水,救人命;医疗上,AI分析数据比医生快,新冠疫苗研发就靠它加速。 可这些好事的前提,是得有规矩。基辛格的意思不是否定AI,而是说没底线不行。就像核能,能发电也能造炸弹,AI也一样,关键看咋用。 基辛格100岁还在操心AI,不是闲的。他活了整整一个世纪,见识过二战、冷战,知道技术失控啥后果。 核弹时代,好歹有大国博弈平衡,AI时代呢?规则空白,谁都可能失手。他晚年写书、发声,呼吁AI治理,就是不想人类再吃技术失控的亏。 咱老百姓咋想AI这事?说实话,AI离生活不远了。手机刷视频靠AI推荐,开车导航靠AI规划,连找工作都得跟AI简历筛选斗智斗勇。 可AI要是失控,咱也跑不掉。比如自动驾驶,特斯拉车主就撞过好几次,AI认错路标直接翻车。基辛格的警告听着遥远,其实跟咱日子息息相关。