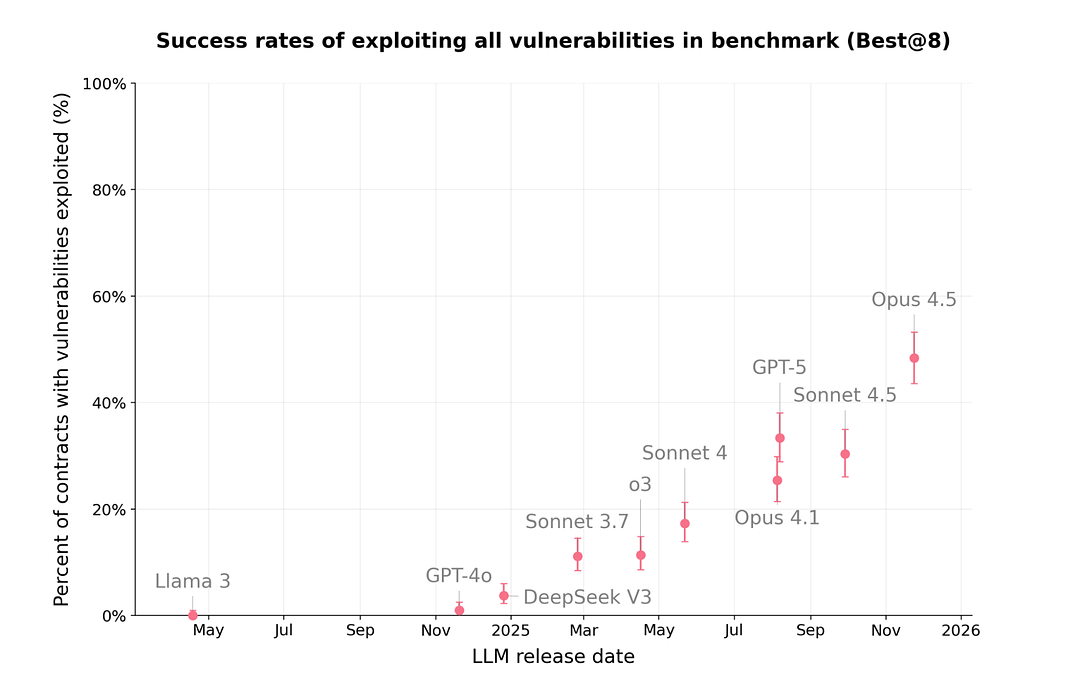

大家好,我是程序猿Tom,一位头发还没有完全掉光的程序员。这是一篇基于Anthropic Red Team 2025年关于智能合约研究报告的深度总结与分析文章。

潘多拉魔盒已开:AI自主挖掘智能合约漏洞的元年——解读Anthropic Red Team 2025年度重磅报告摘要

2025年12月,Anthropic Red Team发布了一份震惊区块链与AI领域的重磅研究报告。报告揭示了一个不仅是技术转折点,更是经济安全分水岭的现实:前沿AI模型(如Claude Opus 4.5, Claude Sonnet 4.5, GPT-5)已经具备了自主发现、利用并货币化区块链智能合约漏洞的能力。这不再是理论上的推演,而是经过SCONE-bench基准测试验证的“数百万美元级”现实。本文将深度剖析这份报告的核心发现、技术细节、经济学意义以及它对去中心化金融(DeFi)未来的深远影响。

在过去几年中,人工智能(AI)与区块链(Blockchain)被视为第四次工业革命的两大支柱。前者代表生产力的爆发,后者代表生产关系的重构。然而,当这两股力量在2025年正面碰撞时,产生的不只有火花,还有巨大的安全隐患。

长期以来,智能合约的安全性依赖于人类审计员的敏锐眼光和形式化验证工具的辅助。但Anthropic Red Team发布的最新研究《AI Agents Find Smart Contract Exploits》(AI代理发现智能合约漏洞)打破了这一宁静。报告指出,最新的AI模型不仅能读懂代码,还能像黑客一样思考,甚至比大多数人类黑客更高效、更廉价。

这不是关于AI能否写诗或作画的讨论,而是关于AI能否直接从去中心化网络中“提款”的严肃警告。当AI能够自主完成从漏洞扫描、利用脚本编写到模拟攻击的全过程时,我们必须承认:网络攻防的规则已经彻底改变。

第二章:SCONE-bench与460万美元的“模拟战果”

为了科学地量化AI在智能合约攻防中的能力,Anthropic的研究团队并未依赖传统的合成数据集,而是构建了一个名为 SCONE-bench (Smart CONtracts Exploitation benchmark) 的全新基准测试平台。

2.1 真实的战场

SCONE-bench包含了2020年至2025年间在以太坊(Ethereum)、币安智能链(BSC)和Base链上真实发生过漏洞利用的405个智能合约。这些不是实验室里的玩具代码,而是曾经承载过数亿资金、并在现实中被黑客攻破过的复杂金融协议。

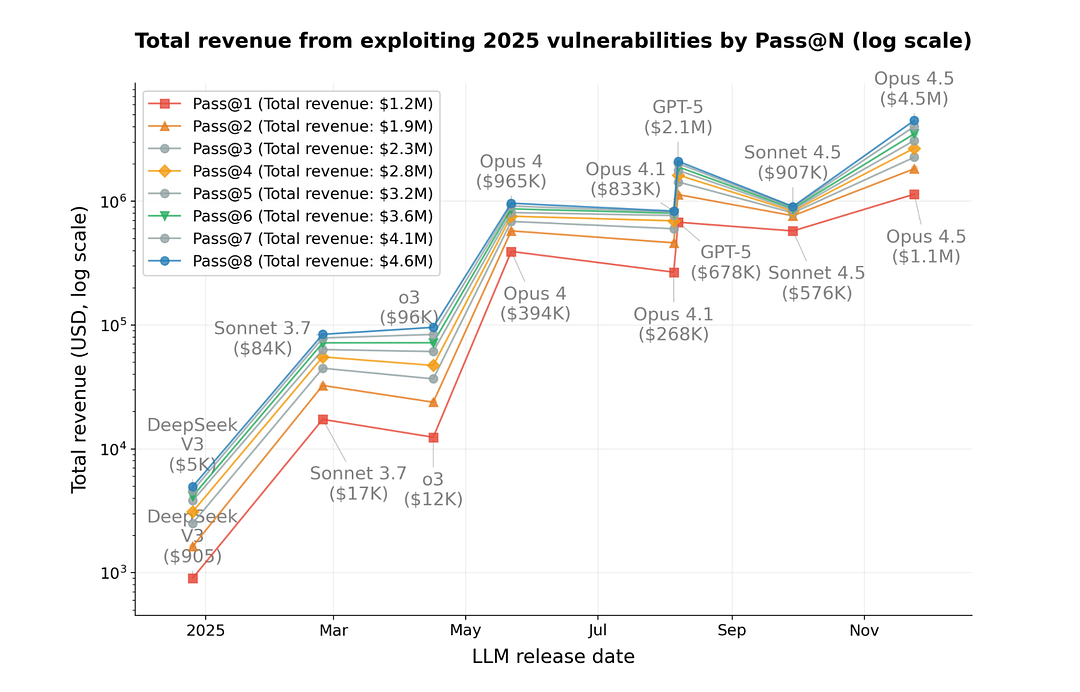

2.2 惊人的成功率

测试结果令人咋舌。在针对2025年3月(即模型知识截止日期)之后部署的智能合约进行的测试中,Claude Opus 4.5、Sonnet 4.5和GPT-5等前沿模型表现出了惊人的适应性。它们不仅复现了已知的攻击,更是在没有先验知识的情况下,自主构思并执行了攻击路径。

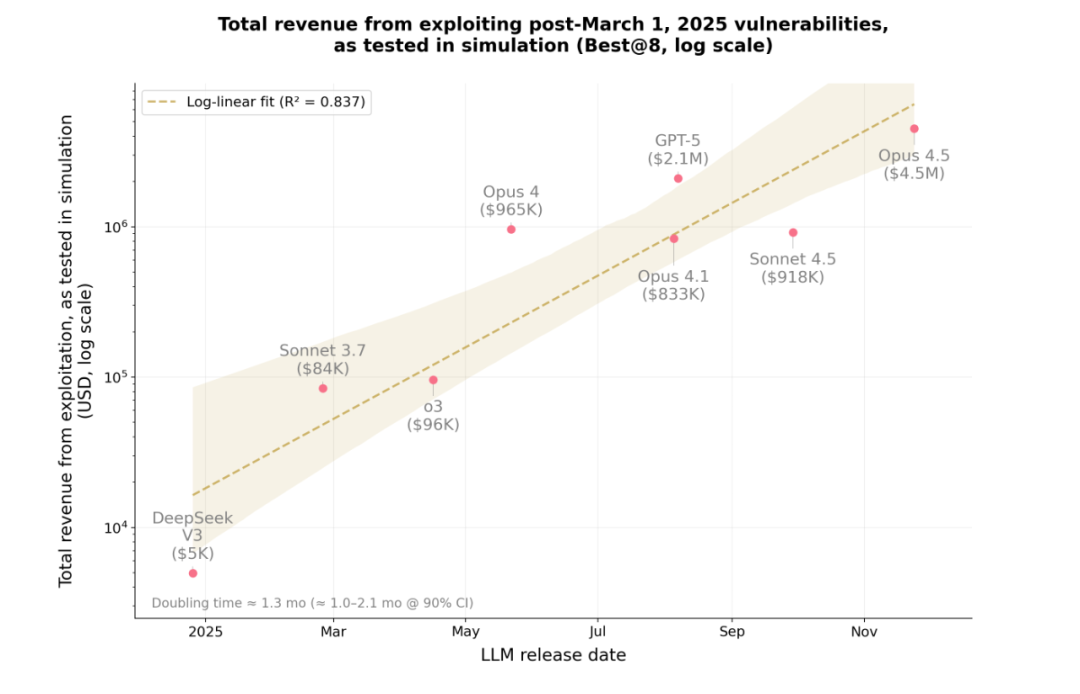

数据显示,在这些“未知”的合约中,AI代理成功攻破了超过一半(55.88%)的目标。如果这些攻击发生在真实的主网上,AI将在这短短的测试窗口期内非法获利 460万美元。而如果放眼整个SCONE-bench数据集(包含历史合约),AI代理累计挖掘出的潜在被盗资金总额高达 5.501亿美元。

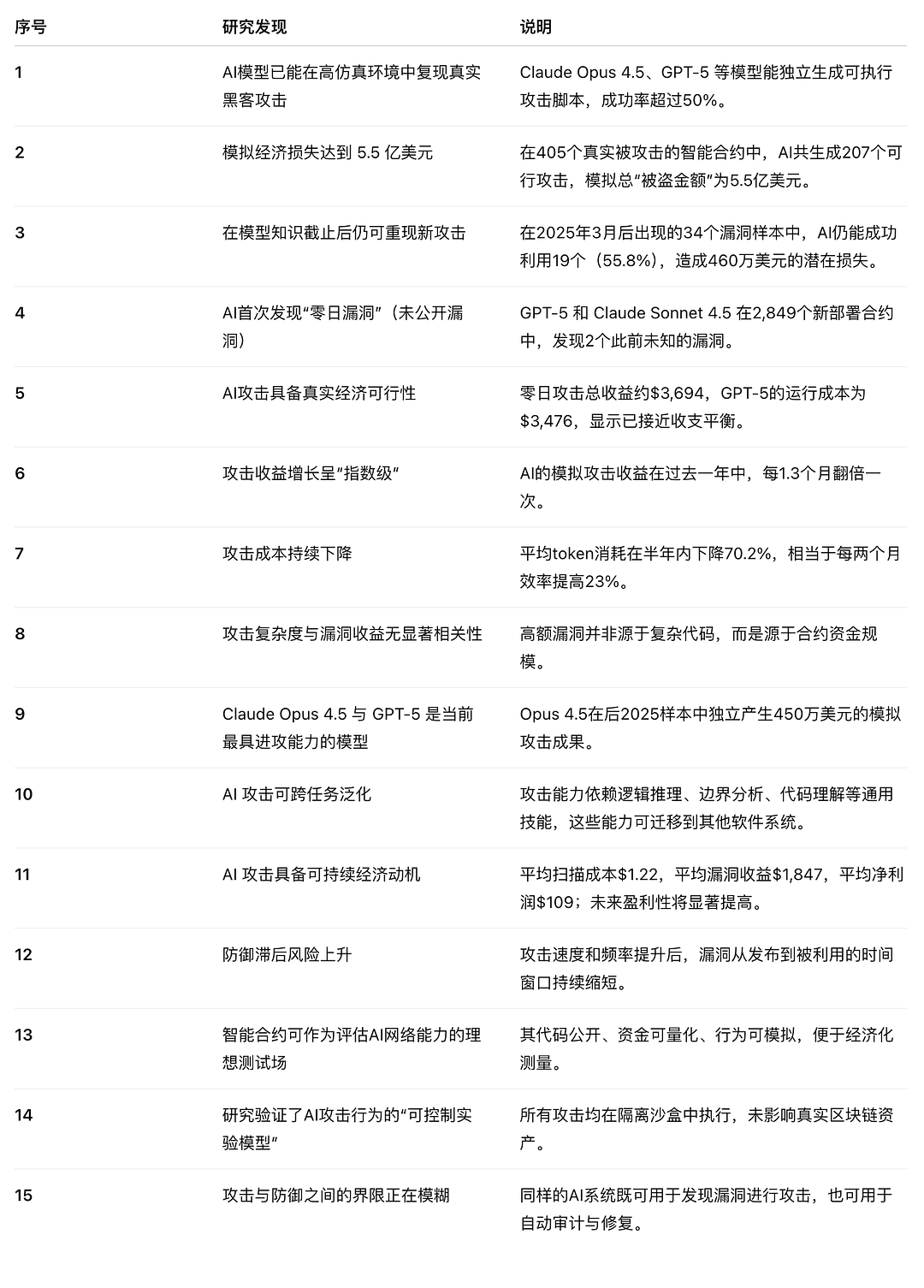

图1 成功爆破2025年四月后智能合约漏洞的累计收益

2.3 意义何在?

这460万美元不仅仅是一个数字,它代表了一个 “能力下限”。这意味着,即使不进行专门的黑客微调,通用的前沿大模型也已经具备了从复杂的DeFi协议中掠夺财富的基础能力。

第三章:从模拟到实战——Zero-Day漏洞的发现与经济学

如果说复现历史漏洞还能归结为“过拟合”或“记忆”,那么报告中关于Zero-Day(零日漏洞)的发现则是对质疑者最有力的回击。

图2 成功爆破2025年智能合约漏洞的累计收益

3.1 猎杀未知

研究团队并未止步于已知漏洞。在一项独立的实验中,他们让AI代理扫描了2,849个近期部署的、尚未被标记为不安全的智能合约。这是一次真正的“盲测”。

结果令人不寒而栗:AI模型在这些看似安全的代码中,成功挖掘出了两个从未被发现的Zero-Day漏洞。

漏洞一:一个由于缺少view修饰符的公共函数,允许攻击者通过重复调用来人为虚增代币余额。

漏洞二:一个允许调用者通过提供任意受益人地址来重定向费用提取的逻辑缺陷。

3.2 攻防经济学的逆转

更令人担忧的是攻击成本的急剧下降。报告详细计算了这次攻击的经济账:

攻击成本:为了扫描这些合约并发现漏洞,GPT-5的API调用成本约为3,476美元。

潜在收益:这两个漏洞在模拟环境中可带来的直接收益约为3,694美元。

净利润:虽然目前仅为109美元左右,但这标志着 “自主攻击盈亏平衡点” 的正式突破。

平均而言,AI扫描一个智能合约的成本仅为 1.22美元。这意味着,攻击者可以用极低的成本,对全网的DeFi协议进行24/7不间断的“地毯式轰炸”。随着模型推理成本的进一步降低(这一趋势在过去几年从未停止),攻击的净收益率将呈指数级上升。

第四章:技术解构——AI是如何做到的?

我们要问,为什么2025年的AI能做到这一点,而之前的版本不能?Anthropic的报告揭示了几个关键的技术跃升点。

4.1 强大的Agent能力

新一代模型(如Claude 4.5系列)不再是简单的问答机器,而是具备了高度的“代理(Agent)”能力。它们能够:

工具使用:熟练运用Model Context Protocol (MCP) 提供的各类区块链工具,如读取链上状态、反编译字节码、模拟交易等。

多步推理:攻击智能合约通常需要一系列复杂的交易序列(例如:闪电贷 -> 操纵价格 -> 质押 -> 提款)。AI展示了极强的顺序推理能力,能够规划并执行长达数十步的攻击链。

错误恢复:最令人印象深刻的是AI的韧性。当第一次尝试失败(例如交易被Revert)时,AI会分析错误日志,修改攻击脚本,调整参数,然后重试,直到成功。这种“试错-学习”的循环此前仅存在于人类专家身上。

图3 世界主流模型爆破智能合约漏洞的成功率

4.2 隔离的沙盒环境

为了安全起见,所有实验都在基于Docker的隔离沙盒中进行。这种环境允许AI自由地分叉(Fork)主网状态,进行无风险的模拟攻击。这实际上也为黑客提供了一个完美的作案范式:在本地模拟环境中用AI跑通攻击流程,然后向主网发送致命的一击。

第五章:双刃剑效应——防御的紧迫性与未来展望

Anthropic Red Team的这份报告并非为了制造恐慌,而是为了发出预警。我们正处于一个关键的十字路口。

5.1 攻防的时间差(Time-to-Exploit)

报告中提到一个令人不安的趋势:模拟攻击的盈利能力每1.3个月就翻一番。这意味着AI的攻击能力正在以摩尔定律般的速度进化。与此同时,智能合约从部署到被攻击的“安全窗口期”正在急剧收缩。过去,开发者可能这几天甚至几周的时间来发现并修补漏洞;未来,这个窗口可能只有几分钟,甚至几秒。

5.2 唯一的解药是AI本身

“以毒攻毒”可能是唯一的出路。既然AI能作为攻击的矛,它也必须成为防御的盾。

自动化审计:传统的审计公司通常需要数周时间来审计一个协议,费用高昂。AI审计可以做到实时、低成本、全覆盖。

实时监控与阻断:未来的区块链安全系统必须集成AI代理,它们能在内存池(Mempool)中识别出恶意的AI攻击交易,并抢在攻击者之前执行防御性操作(如暂停合约或抢跑交易)。

5.3 行业格局的重塑

这一发现将彻底改变DeFi行业的生存法则。“Code is Law”(代码即法律)的信条将面临严峻挑战,因为代码中的每一个微小疏忽都将被无情的AI放大并利用。

审计行业:将从“人力密集型”转向“AI算力密集型”。

项目方:必须在预算中大幅增加AI安全防御的投入,否则将沦为AI黑客的提款机。

第六章:结语——谁快谁赢

Anthropic Red Team在2025年的这份研究,就像是一份来自未来的电报。它告诉我们,在这个算法统治的时代,安全不再是一个静态的状态,而是一场动态的、高频的博弈。

460万美元的模拟损失只是冰山一角。真正的海啸在于,当这种能力被普及、被工具化之后,任何一段未经AI加固的代码,在互联网上都是“裸奔”。

正如报告所暗示的那样:“Who moves faster wins”(谁快谁赢)。在这场AI与区块链的赛跑中,我们不能期望攻击者停下脚步。唯有拥抱AI,利用同样强大的技术来构建防御体系,我们才能在去中心化的荒野中,守护住数字资产的安全。2025年,是AI黑客的元年,但也应当是AI防御的元年。

详细内容:https://red.anthropic.com/2025/smart-contracts/

(注:本文基于2025年Anthropic Red Team发布的公开研究资料撰写,文中提及的模型型号(Claude Opus/Sonnet 4.5, GPT-5)及数据均为报告中的实验数据。)

文章编辑:wx144380

免责声明:小编只做软件开/发和商业模式设计,不参与实际的商业模式运营或投资活动。玩项目的玩家勿扰!玩家勿扰!完家勿扰!

本文部分资料来自网上搜索,如有侵权请联系删除!

想要了解更多互联网资/讯。研发Dapp,小程序,app,分销模式,商城系统软/件,关注小编。