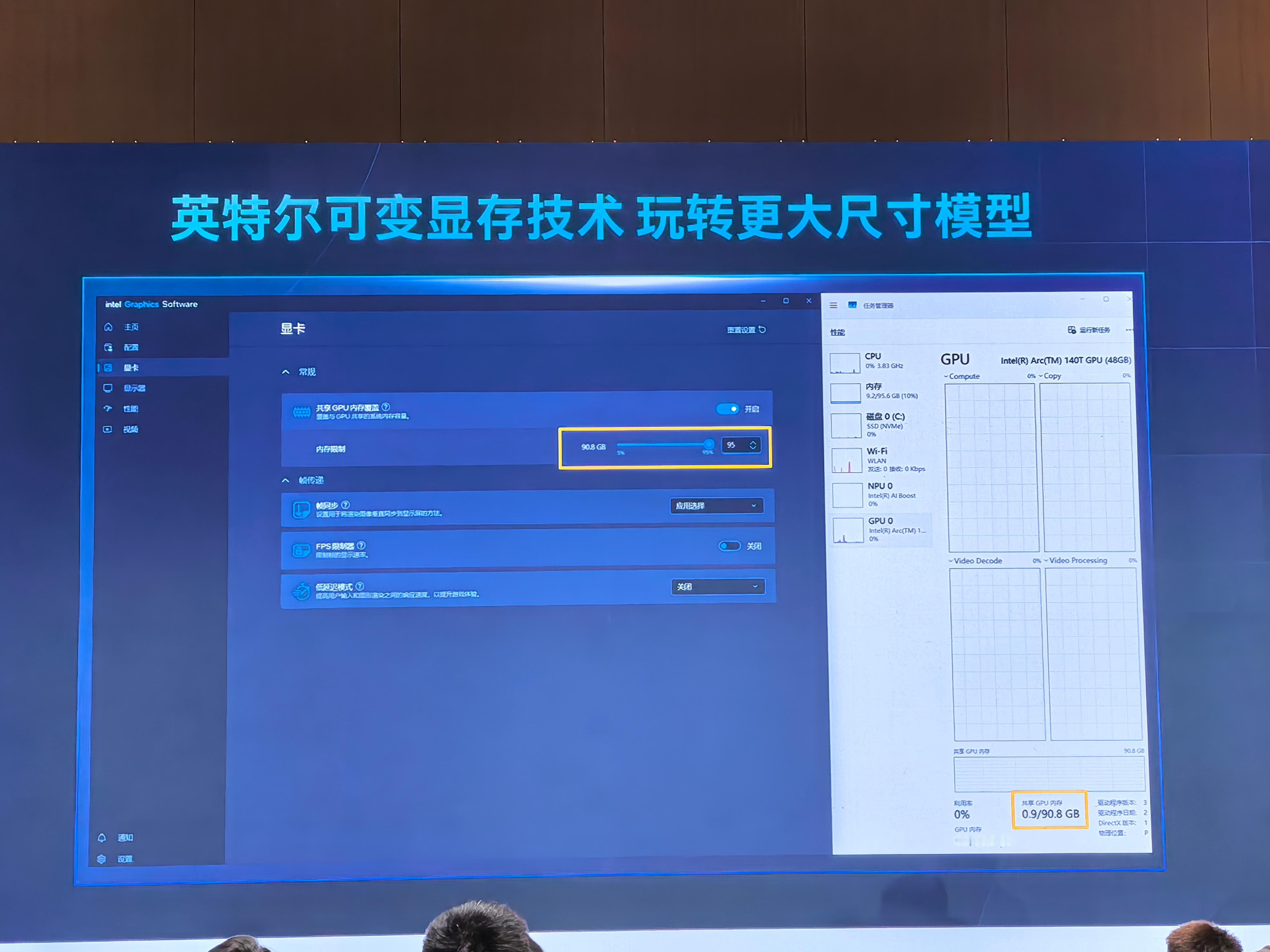

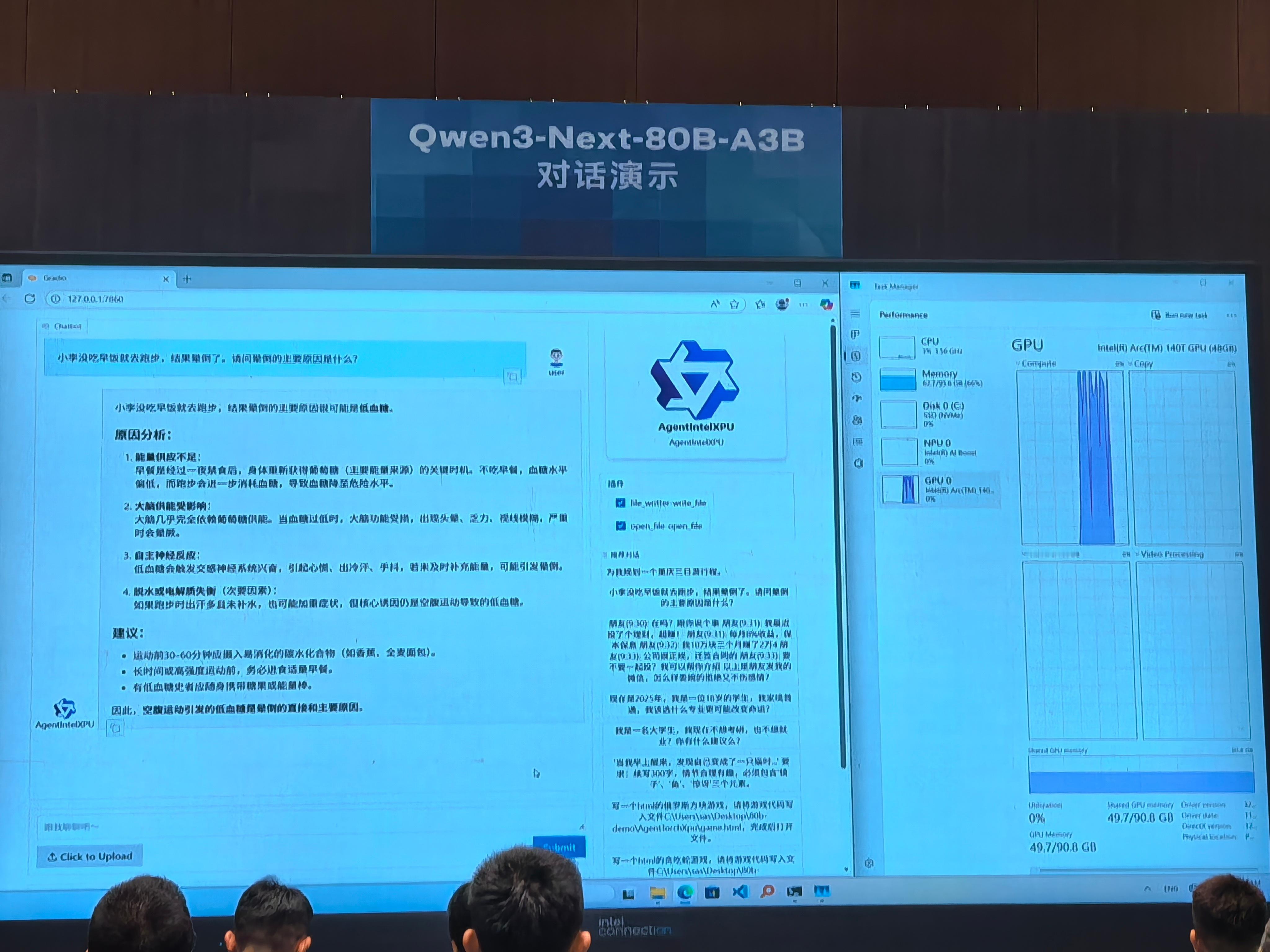

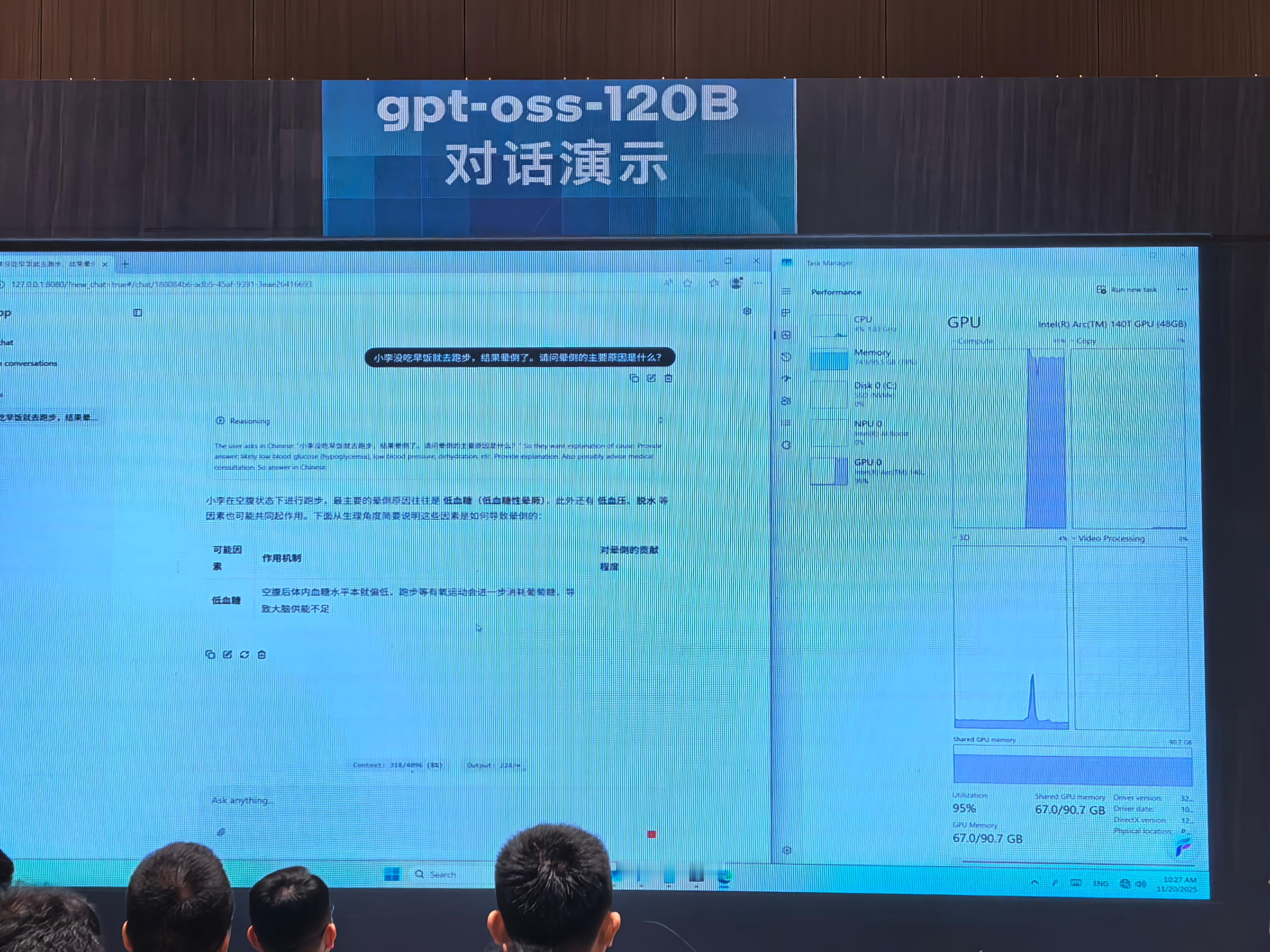

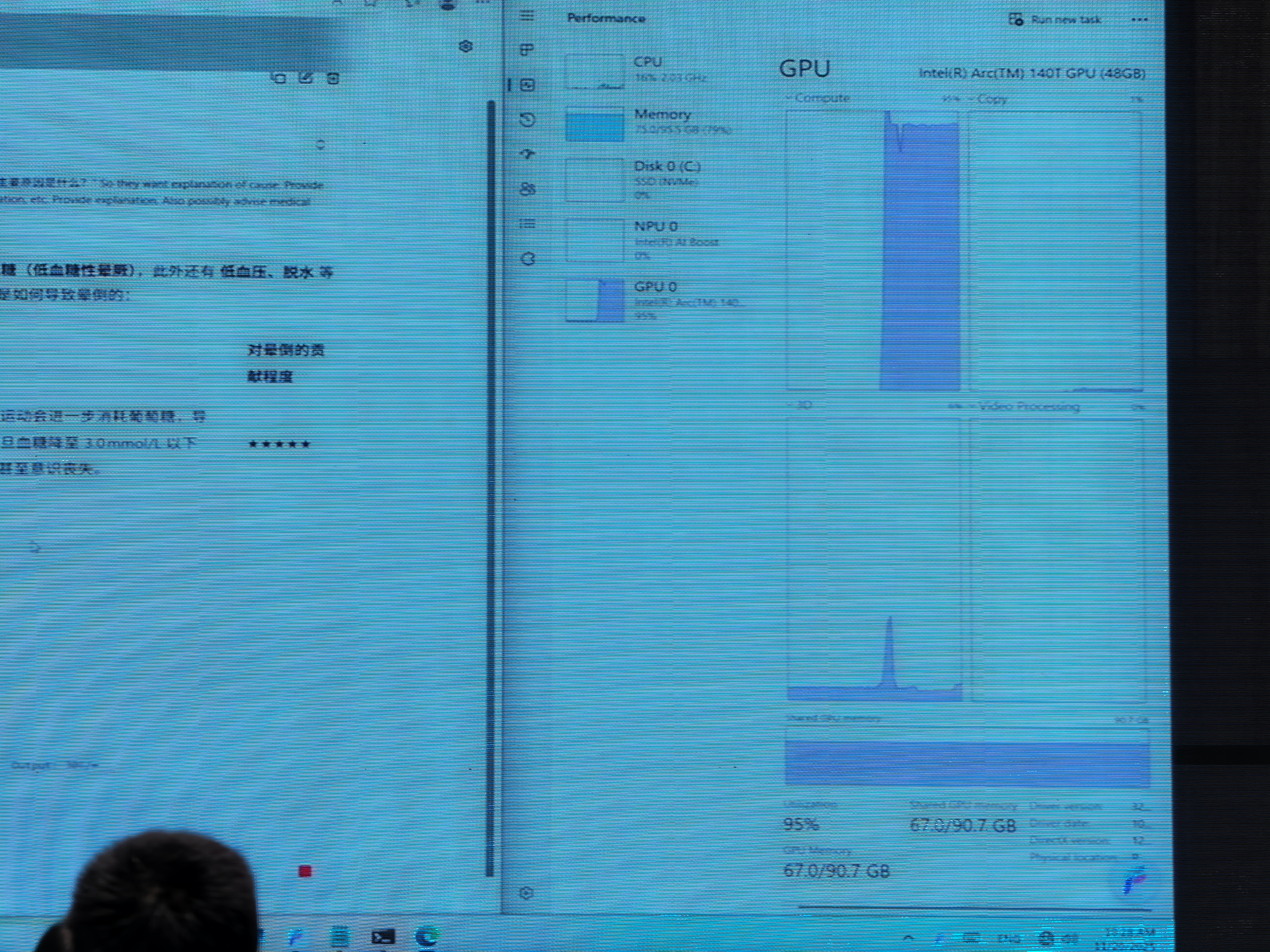

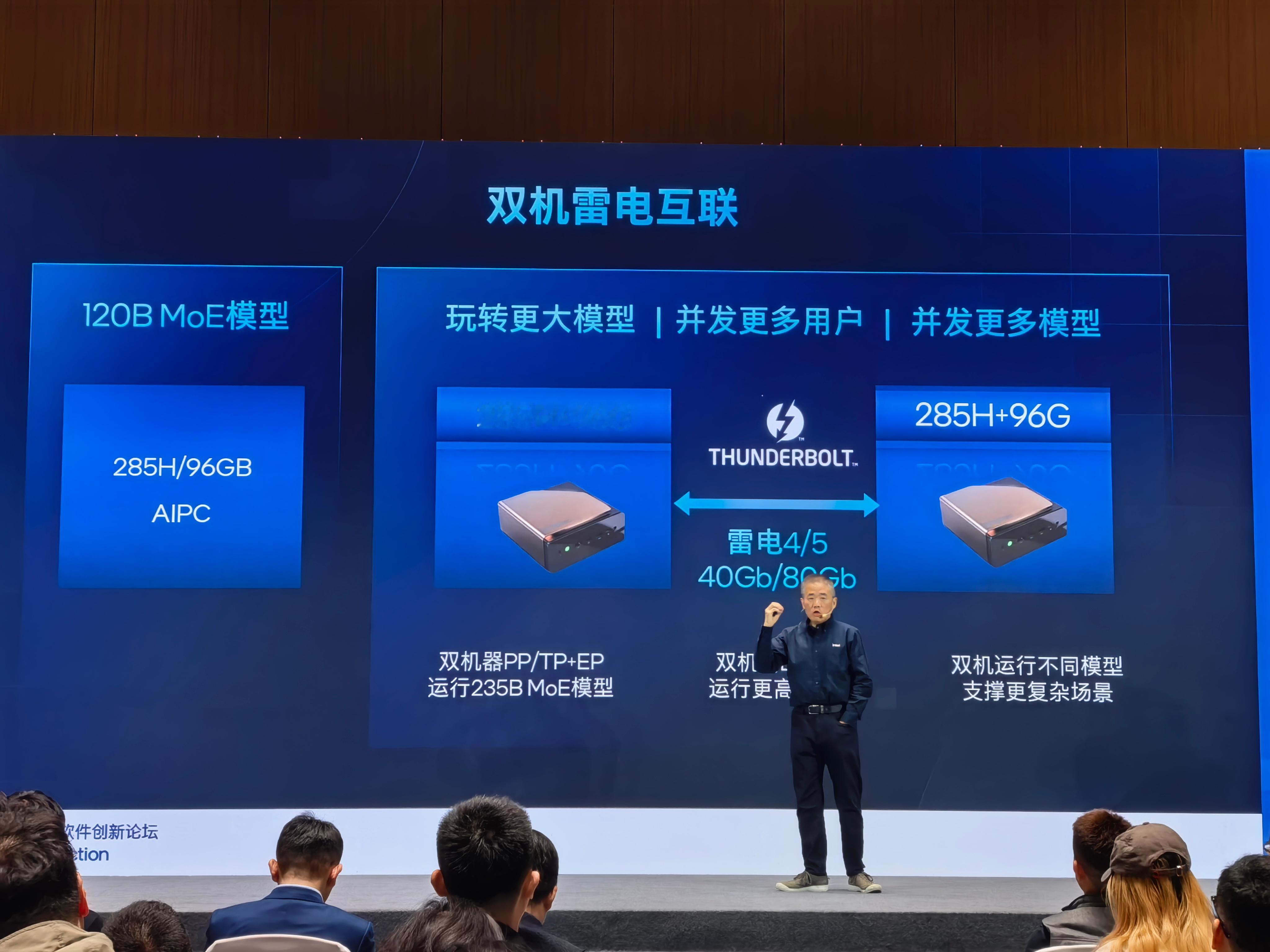

今天在现场看到英特尔带来一整套端侧大模型推理能力的展现:最大支持 128GB 内存、120B 模型加载,真正把“大显身手”落到实处;1、多款迷你主机同步亮相,285H+96GB 组合让口袋大小的机器也能跑大模型;2、可变显存技术直接把 Arc 140V GPU 的显存推到 90GB+,更大 KV Cache、更稳推理;3、现场还展示了 Qwen3-Next-80B-A3B、gpt-oss-120B 的端侧对话,任务管理器里的显存占用体现了可变显存优势。4、双机雷电互联更是绝了,两台迷你机可拼成 235B MoE 模型的“合体形态”;5、与群联合作的 AI SSD也正式亮相,PCIe5.0 拉满,让大模型的上下文、加速效果进一步增强。AIPC 今年真的卷到实处了,从算力、架构到生态都在往“能跑更大模型”的方向全力冲刺。