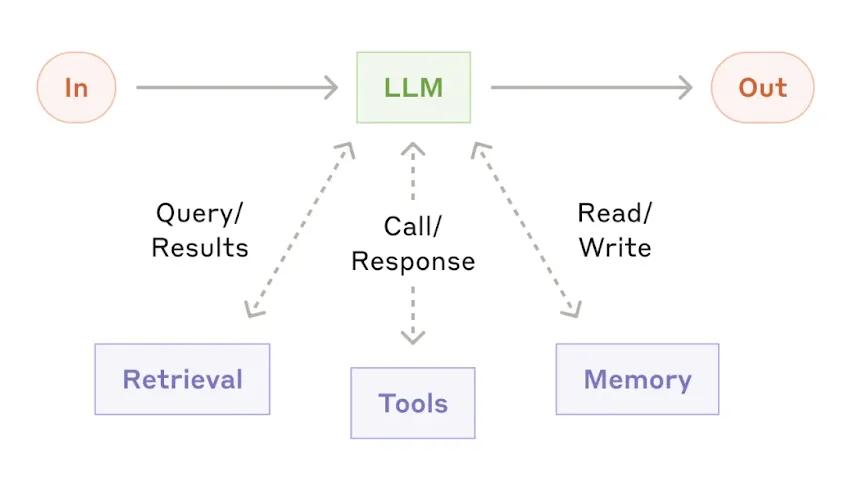

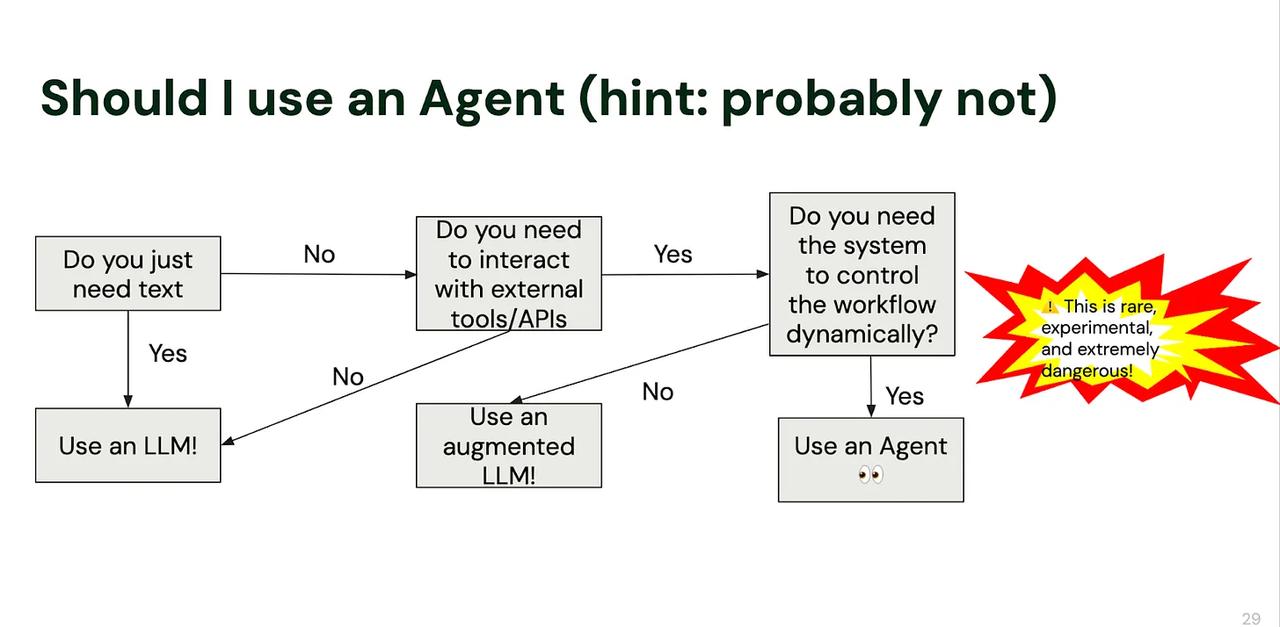

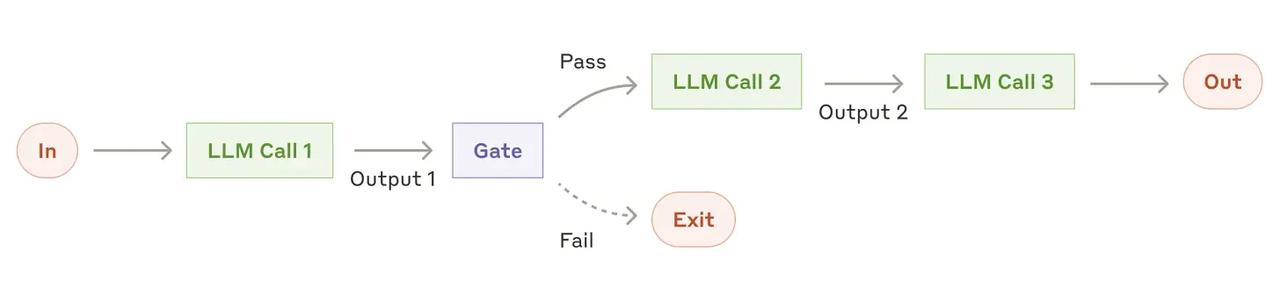

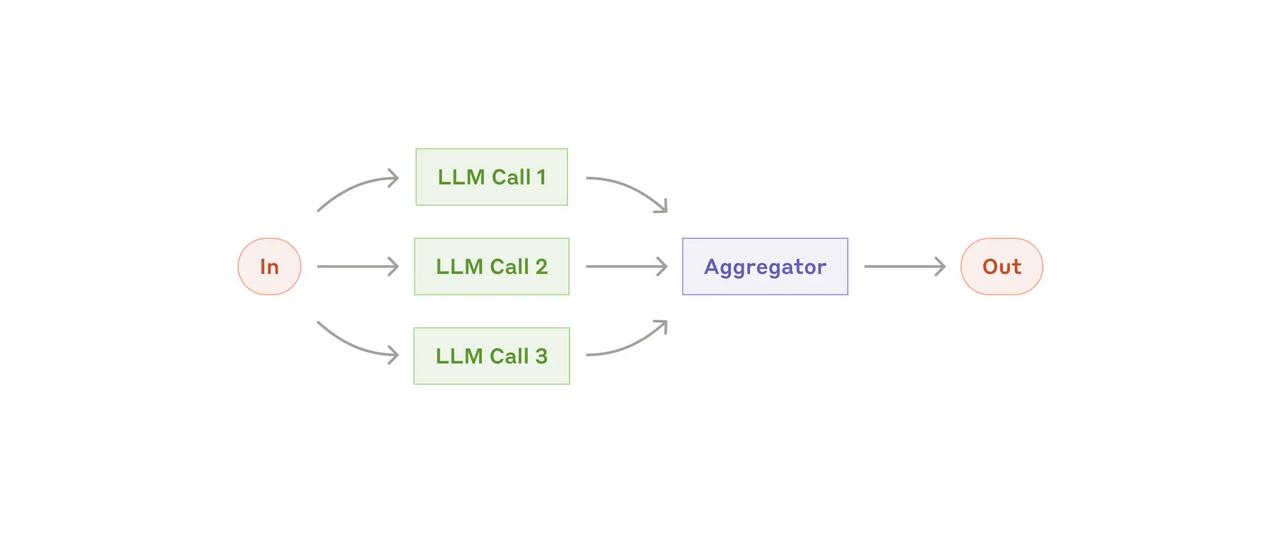

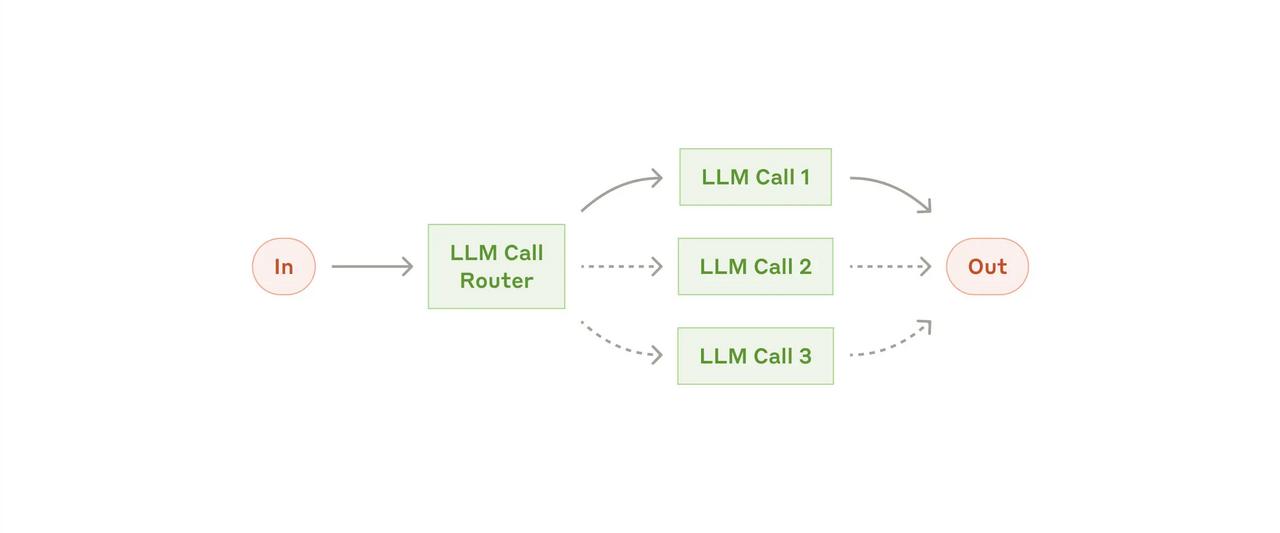

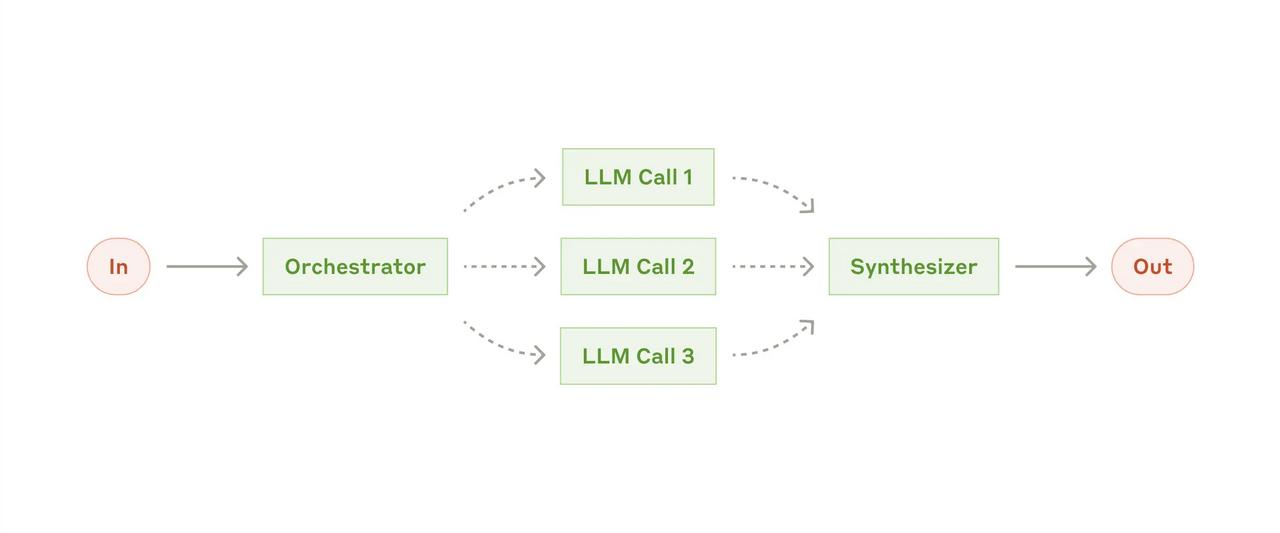

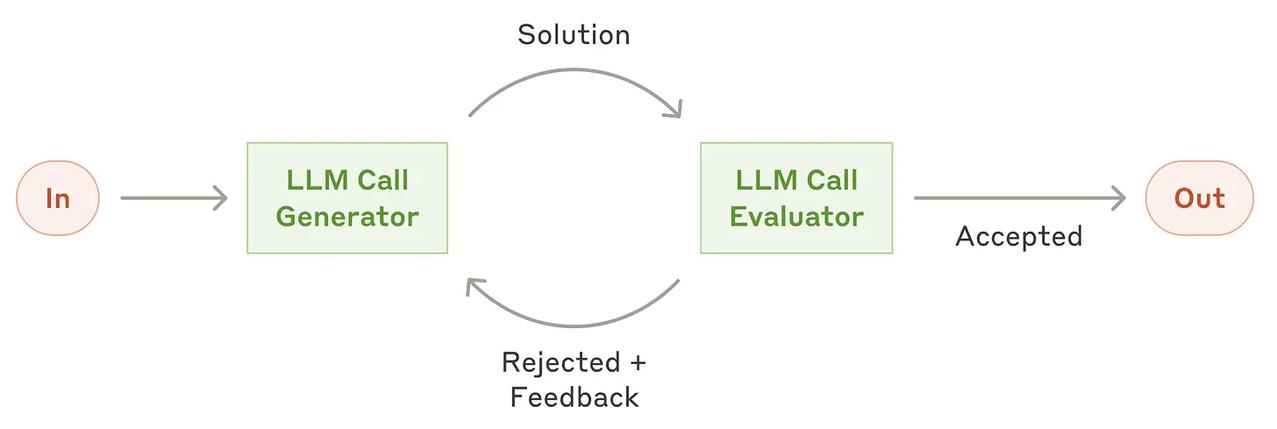

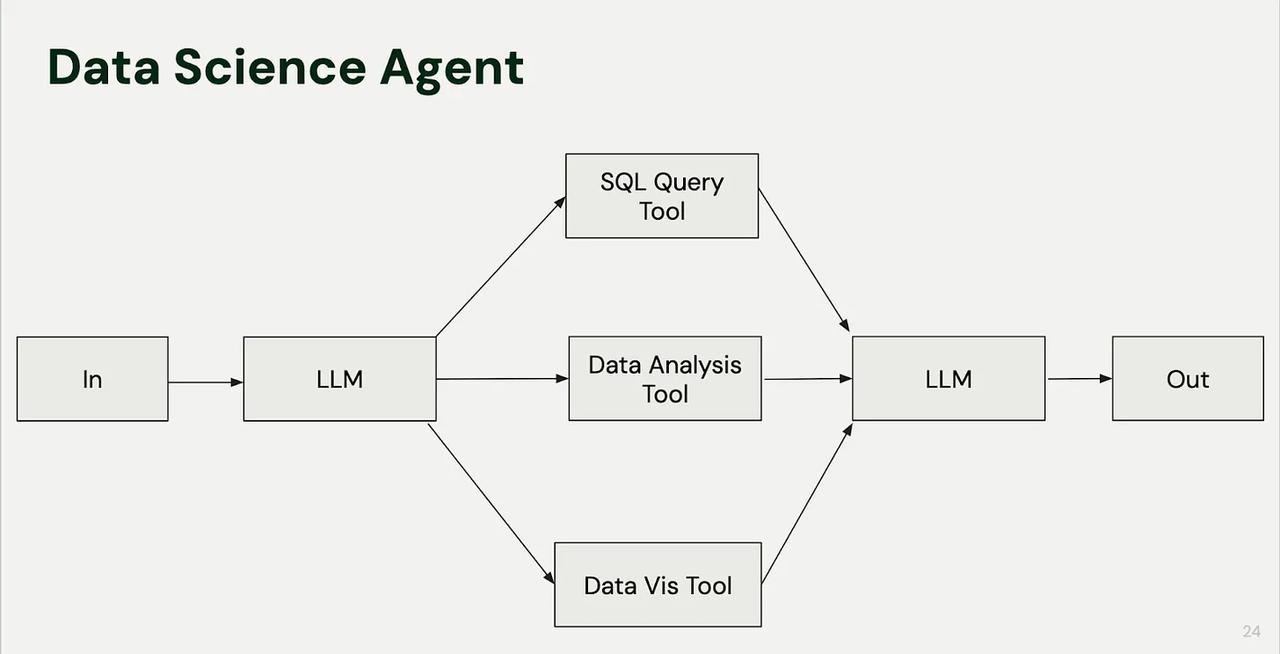

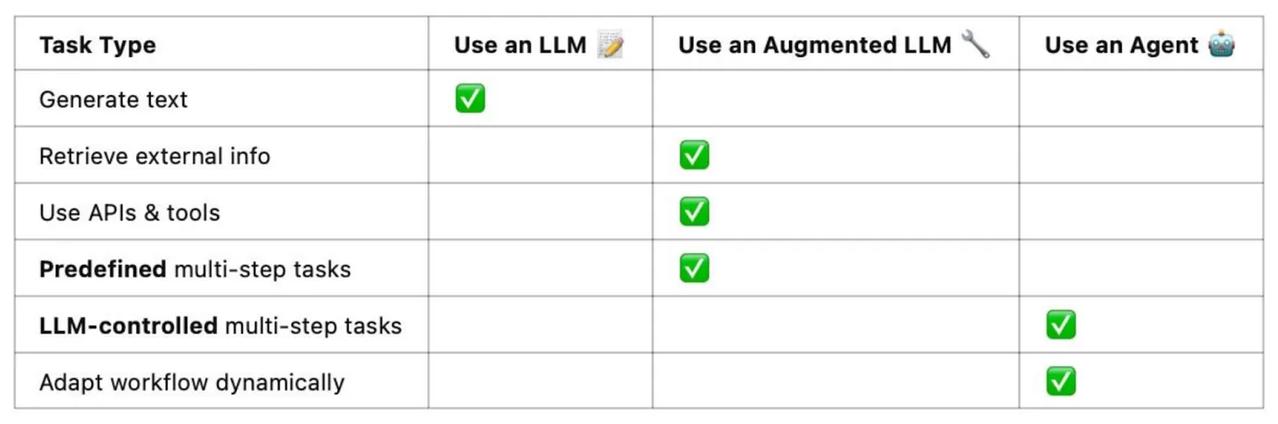

停止构建Agent智能体! 文章作者Hugo表示:只有很少的情况需要构建智能体,大多数时候,AI工作流更好。 要理解这句话之前,我们要先知道,什么是智能体? 智能体系统需要满足4个特征:【图1】 1. 记忆(Memory)——记住过去交互 2. 信息检索(Retrieval)——查外部数据给上下文 3. 工具调用(Tool Use)——接入API或函数 4. 流程控制(Workflow Control)——LLM自己控制使用哪些工具、什么时候调用、怎么走流程 前3项我们叫“增强型(Augmented)LLM”,第4项才是智能体的核心:LLM主导整个决策流程,动态适配任务。 智能体听上去很智能,但问题是:它太灵活,很容易失控。 Hugo用一个真实例子,来说明智能体系统的“优雅溃败”:他用CrewAI搭建了一个研究型智能体团队: - 一个Research智能体去网上查资料 - 一个Summarizer智能体总结内容并引用来源 - 一个Coordinator智能体分配任务 逻辑上很完美,但现实是: - 研究智能体常忽略专门配置好的爬虫工具; - 总结智能体在长文档里忘记引用,忽略上下文; - 协调智能体一遇到模糊任务就卡死,一整个放弃。 那么问题来了,“智能体们”为什么失败?作者Hugo解释道—— - 智能体本身无法准确识别哪些工具适用于当前场景; - 智能体之间缺少人类监督,协调成本高; - 系统看似模块清晰,实际上出错难以追踪、缺乏可控性。 Hugo干脆画了一张【图2】,并表示:只有当任务需要系统“动态改变执行路径”时,才需要智能体。而这种需求,极少。 那什么方案更适合大多数人用? 他总结了5种典型的AI工作流,适合不同类型的任务,结构清晰又容易维护: 1. 串联流程(Prompt Chaining)【图3】 适合任务有明显先后步骤,例如生成个性化邮件: - 第一步:提取结构化信息(公司名、职位) - 第二步:补充公司上下文(愿景、职位空缺) - 第三步:写出个性化邮件 💡优点:线性、可控、容易调试 ⚠️缺点:中间一步出错会影响全流程 2. 并发任务(Parallelization)【图4】(由于原文图没给全,部分图片引用自Anthropic) 适合要同时处理多个子任务,例如抽取简历中的不同信息: - 并行提取工作经历、技能、教育背景 - 然后整合成统一结构输出 💡优点:速度快,适合批处理任务 ⚠️缺点:有异步执行时序问题,需处理超时或数据一致性 3. 分流处理(Routing)【图5】 适合根据输入分类走不同子流程,例如客服系统: - 产品问题 → 技术支持流程 - 退款请求 → 财务流程 - 模糊请求 → 默认兜底流程 💡优点:适配性强,逻辑明确 ⚠️缺点:边界不清晰的输入可能走错路线,需兜底策略 4. 协调-执行模型(Orchestrator-Worker)【图6】 适合需要“分类+分配+多步控制”的任务,但流程仍可预设: - 主控模块(Orchestrator)决定流程路径 - 多个执行模块(Worker)完成子任务 和Routing的区别是:Orchestrator不只是分流,还负责控制整体流程、收集子结果。 💡优点:灵活扩展,支持多轮协调 ⚠️缺点:Orchestrator设计不好容易逻辑混乱 5. 评估-优化回路(Evaluator-Optimizer)【图7】 适合追求高质量输出的任务,例如营销邮件、文案、代码建议: - 初始输出不满足标准 → 给出反馈优化 → 循环直到合格或达到次数上限 💡优点:支持逐步优化、对质量把控更强 ⚠️缺点:可能出现死循环,需设置上限 最后Hugo强调,任务复杂度高、路径难以预定义的任务,如果一定要用智能体,则需要有人类把控,例如: - 数据分析:写SQL→可视化→总结 → 需要人判断输出合理性【图8】 - 创意任务:生成标题、重写文案、建议排版 → 需要人反馈 - 高不确定性环境下快速迭代 → 人可中途调整智能体行为 值得注意的是,智能体无论如何都不适合稳定的企业系统。如财务、医疗、法律等对流程确定性要求高,这样的生产系统中,智能体自由度太高,会导致不可预测的行为。 原文链接:-building-ai-agents