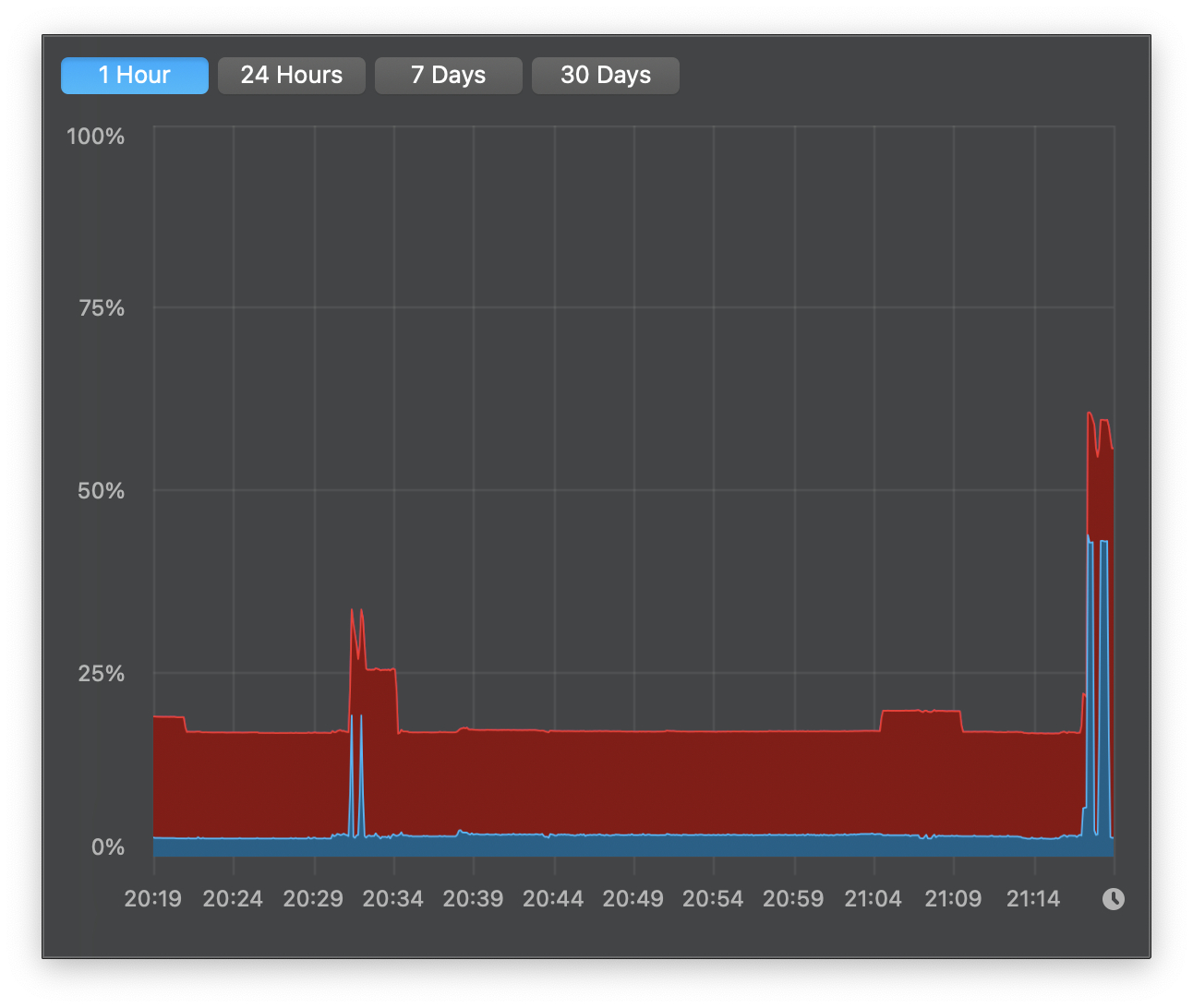

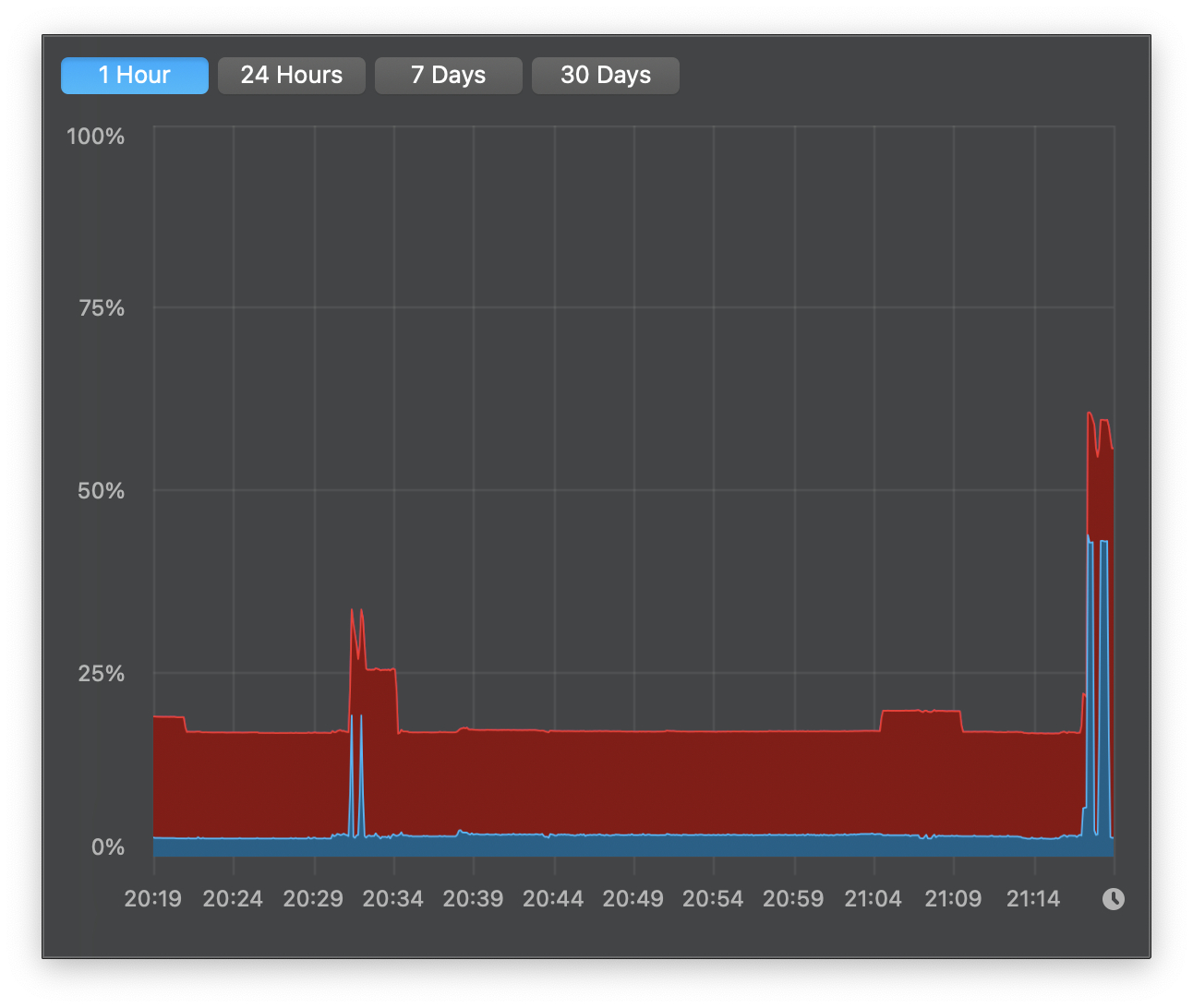

之前在 MacBook 上只部署过 70b 左右的 deepseek、千问,128G 内存只用了 60G 左右。今天心血来潮,想试试部署个带视觉的模型,于是找了个 90b 的 llama3.2-vision,居然也能跑,但跑出来的水平只能说凑合。

本地部署的这种小模型,还是只能拿来玩玩儿,干不了啥正事。

之前在 MacBook 上只部署过 70b 左右的 deepseek、千问,128G 内存只用了 60G 左右。今天心血来潮,想试试部署个带视觉的模型,于是找了个 90b 的 llama3.2-vision,居然也能跑,但跑出来的水平只能说凑合。

本地部署的这种小模型,还是只能拿来玩玩儿,干不了啥正事。

作者最新文章

热门分类

汽车TOP

汽车最新文章