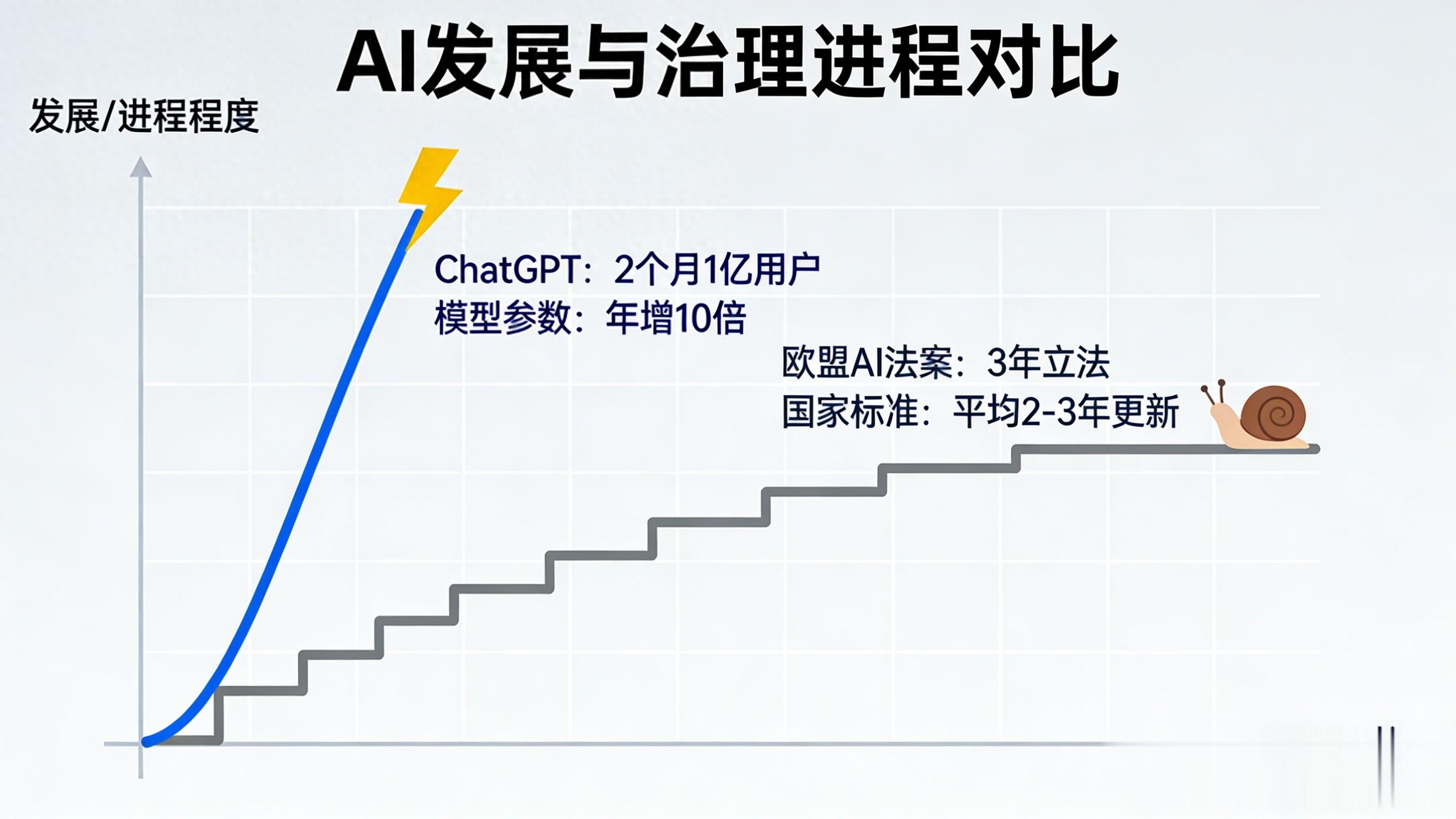

人工智能正在以前所未有的速度改变世界,但我们的管理思维还停留在过去。ChatGPT用2个月就获得1亿用户,而一部AI法律往往需要数年才能出台。

这种“技术狂奔、规则跛行”的现状,正在制造真实的风险。

看不见的危险我们担心数据泄露,却忽略了更根本的问题:AI正在悄悄改变权力分配。

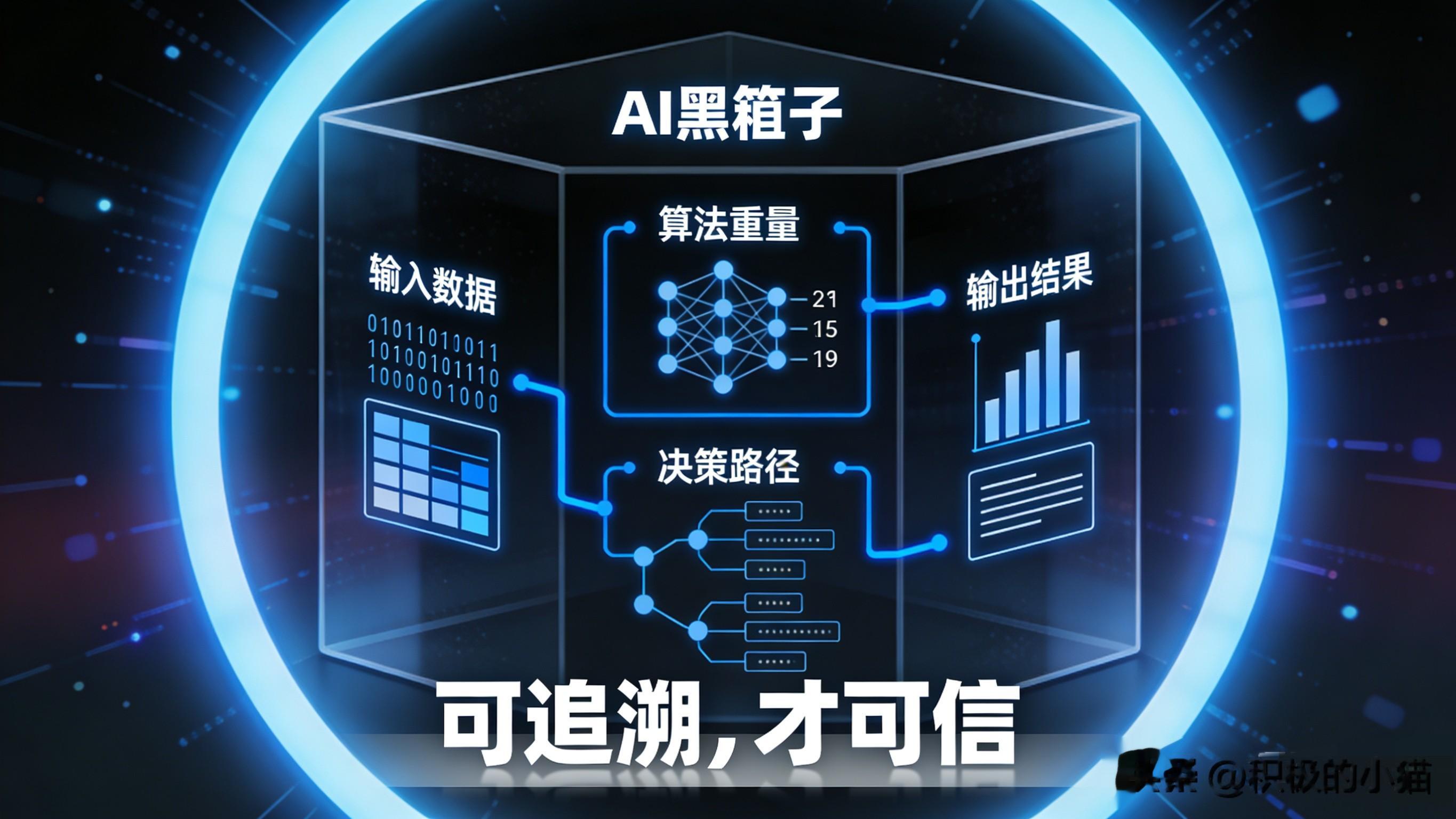

当法院用AI评估罪犯风险、公司用AI决定是否录用你、政府用AI分配社会福利,这些看似中立的算法,实际上在替人类做重大决定。

更值得警惕的是,定义“公平”“正确”的标准,正从社会大众转移到少数科技公司的工程师手中。

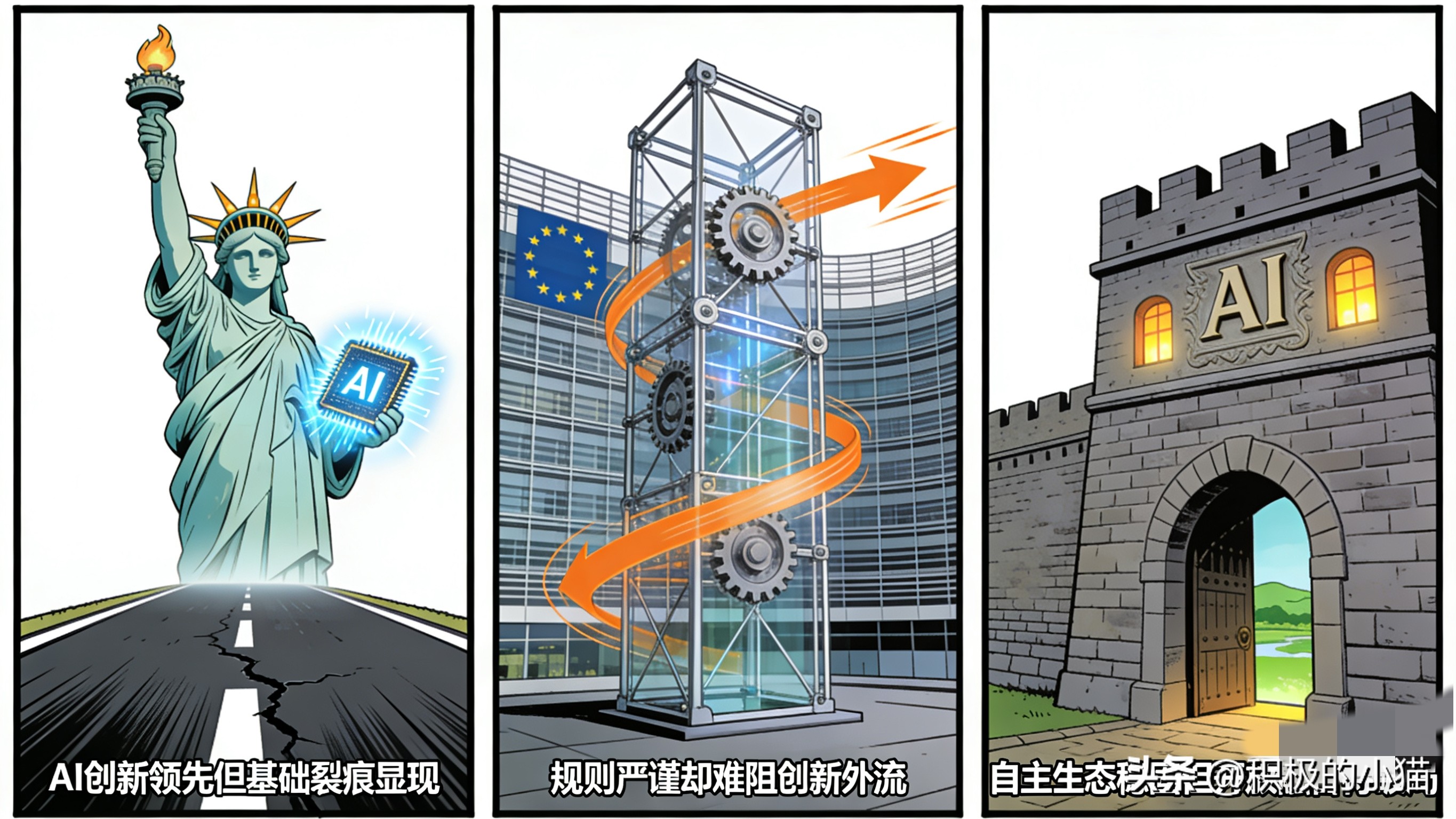

全球治理的困境每个国家都在两难中挣扎:

美国技术领先,但监管跟不上

欧盟规则严格,但创新受影响

中国追求自主,但生态可能封闭

没有完美选择,只有艰难取舍。

更复杂的是,开源AI让监管更难——任何人都能下载、修改、传播AI模型,传统国界在代码面前几乎失效。

老方法解决不了新问题我们还在用管理传统行业的方式管理AI:

1. “监管沙盒”如同在泳池测试远航——AI在实验室表现安全,到真实世界可能完全失控

2. 企业伦理准则常常沦为摆设——当利润与道德冲突时,结果往往令人失望

3. 国际协作跟不上技术扩散——各国标准不一,AI风险却无国界

我们需要新思维

我们需要新思维面对AI,传统“预防原则”(证明安全才能用)可能扼杀创新,完全放任又风险太大。可行的路径是建立动态适应的治理体系:

对企业:要求AI系统像飞机一样有“黑匣子”——决策过程可追溯、可解释

对政府:监管要像软件一样“持续更新”,设置“紧急制动”机制

对公众:保持清醒——AI是工具不是神明,培养自己的判断力比盲目信任更重要

技术发展不会等待我们想清楚所有规则。

真正的挑战不是找到完美方案,而是在不确定中做出负责任的选择。

AI治理的最终问题其实是:当机器越来越智能,我们如何守护好人之为人的价值?

这个问题没有标准答案,但如果我们连问都不敢问,可能就真的来不及了。