谷歌的张量处理单元(TPU)并非普通芯片,而是专门为机器学习任务量身定制的专用集成电路(ASIC)。与通用处理器不同,TPU从设计之初就瞄准了AI计算的核心需求——高效的矩阵运算。

TPU的核心秘密在于其独特的“脉动阵列”架构。想象一下,数千个乘法累加器像流水线一样排列,数据从左到右流动,每个单元完成一次乘法并将结果传递给下一个,最终输出所有乘法的总和。这种设计使得TPU在处理神经网络所需的大规模矩阵运算时,效率远超传统芯片。

TPU的实战表现:支撑谷歌AI帝国

从谷歌搜索到地图导航,从Gemini大模型到照片识别,TPU已经成为谷歌AI服务的隐形支柱。更令人惊讶的是,就连竞争对手苹果也在使用谷歌的TPU来训练其Apple Intelligence模型。

TPU的应用场景远不止于此:Anthropic使用TPU训练其聊天机器人Claude,Waymo依靠TPU开发自动驾驶系统,各大科技公司都在利用TPU构建推荐引擎和面部识别系统。这些应用共同证明了TPU在现实世界AI部署中的关键作用。

虽然英伟达GPU在AI训练领域占据主导,但谷歌TPU在特定场景下展现出明显优势:

能效比优势:TPU专为TensorFlow优化,在执行特定AI工作负载时,能够用更少的能量完成更多计算。内部研究显示,最新的Trillium TPU比前代产品碳效率提高了三倍。

成本效益:尽管高端TPU单价不菲,但其加速模型训练的能力可以显著缩短产品上市时间,从总体拥有成本角度看具有竞争力。

规模化能力:TPU Pod设计允许多个TPU芯片协同工作,实现了真正的横向扩展。训练PaLM这样的巨模型时,TPU Pod展现了无与伦比的并行处理能力。

谷歌自2015年推出第一代TPU以来,已经走过了七代产品的技术迭代。最新的Ironwood TPU标志着战略重点从训练向推理的转变,致力于降低延迟、提高能效,为企业级AI应用铺平道路。

每一代TPU都在前代基础上实现突破:v2引入了TPU Pod概念,v3采用液冷技术,v4通过电路开关加速芯片间通信。这种持续创新使TPU始终保持在AI硬件的前沿。

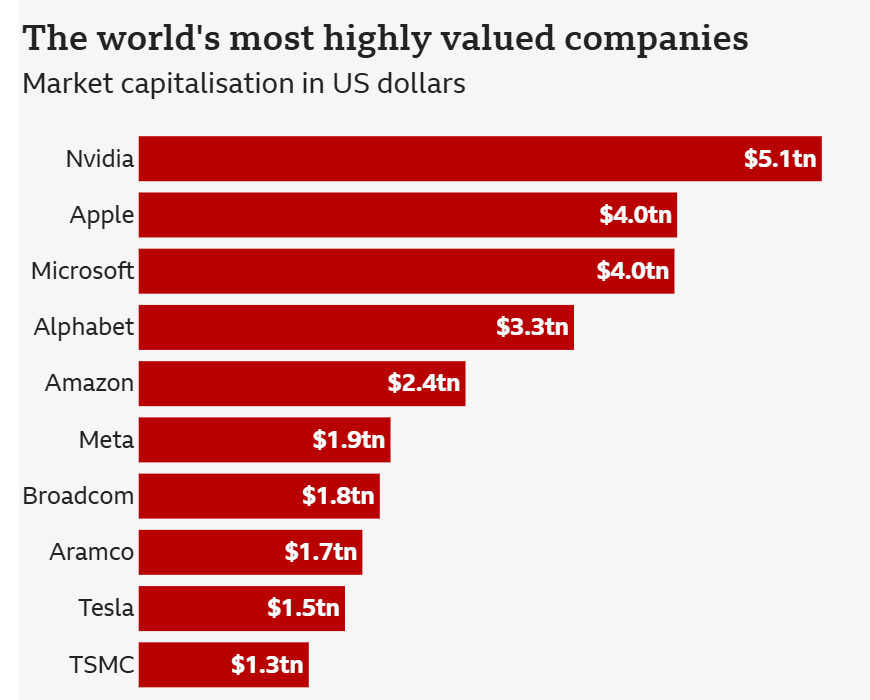

市场格局:AI芯片大战升温根据Statista数据,2024年AI芯片市场规模已达710亿美元,预计2025年将增长30%。在这个快速增长的市场中,谷歌TPU正与英伟达GPU、亚马逊Inferentia、Meta的MTIA和微软Maia展开激烈竞争。

值得注意的是,地缘政治因素正在重塑AI芯片格局。中国研究人员已开发出首个碳纳米管TPU,为这场技术竞赛增添了新的变数。

未来展望:TPU的挑战与机遇TPU面临的主要挑战包括对TensorFlow框架的依赖、仅通过谷歌云服务的访问限制,以及在通用性方面的局限。然而,谷歌正在逐步开放对JAX和PyTorch的支持,未来可能进一步扩大TPU的适用范围。

随着AI从训练走向推理的时代到来,谷歌TPU凭借其在能效、成本和规模化方面的优势,有望在即将到来的“推理时代”扮演关键角色。虽然短期内英伟达仍将保持领先,但谷歌TPU已经证明了自己在AI硬件生态中不可或缺的地位。

在AI芯片这个价值万亿的赛道上,TPU不仅是谷歌的技术护城河,更是推动整个AI行业向前发展的重要力量。随着Ironwood等新一代TPU的部署,谷歌正在为更加高效、可持续的AI未来奠定基础。

评论列表